ملخص

للأسئلة يتم فقدان المعلومات الإصبع الوريد في الفضاء على شبكة عصبونية التفافية (CNN)، نقترح الإصبع الوريد كبسولة الاعتراف شبكة خوارزمية مقرها (كبسولة الشبكة، CapsNets) من. تشكيل CapsNets ينتقل "كبسولة" في دورة كاملة من الأسفل إلى الأعلى، حتى لا تضيع الإصبع الوريد حزمة متعددة الأبعاد الميزة في شكل ناقلات، حيث يتم حفظ الشبكة، والانتعاش. 60000 الصور على أنها مجموعة تدريب 00010 يظهر في الصورة مجموعة الاختبار عن طريق تحسين الصورة، وبعد التعلم اقتصاص. التجارب تشير إلى أن، بالمقارنة مع السمات الهيكلية CapsNets شبكة CNN عند التعامل مع تأثير منطقة خط ريدج هو أكثر وضوحا، ازداد VGG النقيض من دقة 13.6، وفقدان CONVERGES إلى قيمة 0.01.

ضيق تحسين المنزل: يشير إلى الديكور الداخلي، المناظر الطبيعية هو من وجهة نظر بحيث المساحة الداخلية أكثر جمالا.

تعميم وتحسين المساكن وتشمل: التحول من المساحة الداخلية، والديكور، واليوم نحن نتحدث عن تحسين المساكن وعلى نطاق أوسع لتحسين المنزل هو الديكور الداخلي الشامل والديكور.

شكل الاقتباس الصيني: ذكر له يو تشنغ بو، يشير شيونغ سلم نعمة. واستنادا الاعتراف كبسولة الوريد إلى الشبكة التكنولوجيا الالكترونية، 2018،44 (10): 15-18.

الإنجليزية شكل الاقتباس: يو Chengbo، شيونغ الدين. أبحاث حول الإصبع الوريد الاعتراف على أساس شبكة كبسولة . تطبيق تقنيات الالكترونية، 2018،44 (10): 15-18.

0 مقدمة

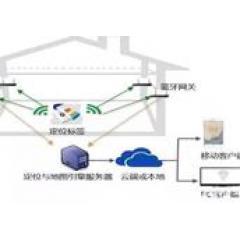

في السنوات الأخيرة، وتطوير من اليوم تعلم الآلة بواسطة التحديثات اليوم، فإن خوارزمية التعلم عمق أيضا تحديث تقدم. منذ إنشائها في عام 2012 AlexNet ، وحتى عام 2017 VGG ، GoogleNet ، وتحسين ResNet وغيرها من الشبكات، نسخة محسنة ظهور للتأكد من أن عمق تعلم خوارزمية ImagNet التحدي في تصنيف الصور أفضل بكثير من خوارزميات تصنيف أخرى. الشبكة العصبية التلافيف (CNN) المستخرجة من المميزات الإلتواء، ورسم الخرائط من أسفل إلى أعلى، لتنفيذ تقريب وظيفة معقدة، أثبتت القدرة على التعلم الاستخبارات. وثيقة الهدايا وتحسين شبكة التدريب وصورة AlexNet الإصبع الوريد، والتفاف نواة 3 3-1 1، ويقلل من عدد من الخرائط الميزة، بعد دورة 50،000 مرات، ومعدل الاعتراف 99.1. وثيقة شبكة التدريب VGG باستخدام صورة الإصبع الوريد، وعلى النقيض من جودة منخفضة، وتدريب النتائج في الجودة، وطبقة عالية الجودة صورة طبقة 16 شبكات VGG شبكة VGG 19، طبقة 16 حيث نسبة الخطأ هو ما يصل الى 0،396 شبكات VGG ( صورة ذات جودة عالية).

من خلال تدريب معايير صور بجودة عالية، وتستخدم CNN لإصبع الوريد الاعتراف، ولكن كما أن لديها بعض المشاكل العملية. جمعتها جمع الصور جامع لديه فرصة كبيرة جدا لالضحلة إصبع صورة الوريد، بينما يستند معالجة الصور على مصفوفة ثنائية الأبعاد، CNN العالمية صورة الإصبع الوريد عندما ميزة التعلم لا يعمل بشكل جيد، مخبأة في الجدول لا يتم تعلمه القشرة IV المؤخرة، لذلك سوف يؤثر تأثيرا خطيرا على دقة التعرف.

كما هو مبين، صورة الوريد التي تحتوي على الضحلة الوريدي المحلي أصغر حجما وأخف وزنا في اللون، والتوزيع غير المتكافئ لا يكتمل، ويؤدي إلى السبب الرئيسي هو لأن المقارنة هذا المنوال، وكاميرا الأشعة تحت الحمراء لا يمكن أن يكون واضحا من خلال الأنسجة اطلاق النار. ومع ذلك، فإن الصورة الطبيعية للسمك الوريد، وتوزيع لون موحد إلى حد كبير.

ديسمبر 2017، اقترح HINTON GE CapsNets شبكة هيكل ، والتدريب على دقة multiMINIST من 99.23، لتحقيق دقة على مجموعة اختبار affinist 79، وهو ما يتجاوز بكثير من 66 CNN، في حين CapsNets أقل استهلاكا للوقت، هو حاليا أعلى شبكة دقة . إصبع صورة الوريد غالبا موجودة متداخلة الوريد، مما أدى إلى عملية الحصول على الصور تداخل الوريد غالبا ما يحدث. CNN التعلم ضعف موقف المكاني، بحيث عند التقاط الحصول على الصور وافر من الأوقات لديها نفس الإصبع، مثل ميزة التعلم تعيين كل عرق وCapsNets موقف في الفضاء من الصورة الوريد معالجة أكثر CNN، تنتقل عملية التعلم في شكل "كبسولة" من الأسفل إلى الأعلى، مجموعة ميزة متعددة الأبعاد، مما يقلل من عدد من تدريب عينات مع الإبقاء على احتمال ضعيف ميزة حدوث الوريد. لهذا السبب يتم تطبيق المقترح هنا CapsNets الإصبع الوريد طريقة الاعتراف.

1 CapsNets

هندسة الشبكات 1.1

بعض المهام الرئيسية في رؤية الكمبيوتر يتطلب بنية مختلفة وقد تم الاعتراف CNN، CNN تصنيف الصور تأثير من قبل الباحثين الجميع، ولكن المشاكل التالية:

(1) CNN لقبول عدد كبير من الصور التدريب، مما يجعل الحصول على عينات التدريب لقضاء الكثير من الوقت، ولكن CapsNets استخدام بيانات التدريب أقل للتدريب.

(2) CNN لا يمكن التعامل بشكل جيد مع الغموض. CapsNets حتى في مشاهد كثيفة، يمكن أيضا أداء جيدا.

(3) CNN يفتقد الكثير من المعلومات في طبقة تجميع. تجميع طبقة اتخاذ أقصى للاحتفاظ ظهور احتمال أكبر من الميزات، بينما التقريب تظهر ميزات أقل الاحتمالات، ونحن غالبا ما تحتاج هذه المعلومات الهامة. وهذه الطبقات تقلل من القرار المكانية، لذلك مدخلاتها لا يمكن أن يكون الناتج التغييرات الصغيرة والاستجابة. عندما يكون ذلك ضروريا للحفاظ على معلومات مفصلة عبر الشبكة، والتي هي مشكلة. اليوم، والحل لهذه المشكلة هو لاستعادة بعض المعلومات المفقودة من خلال إنشاء بنية معقدة حول CNN. لمزيد من المعلومات CapsNets يتم الاحتفاظ الممتلكات في جميع أنحاء الشبكة بدلا من منصبه بعد انتعاش الخسارة. أدخل التغييرات الصغيرة تؤدي إلى بعض التغييرات الطفيفة في الانتاج، يتم الاحتفاظ المعلومات، وهذا ما يسمى تمسخ وهلم جرا. لذلك، يمكن CapsNets استخدام نفس بسيطة وبنية متسقة في المهام البصرية المختلفة.

(4) CNN تتطلب مكونات إضافية لتحديد المكون الذي ينتمي الكائن تلقائيا. ويمكن الحصول على CapsNets عضوا التسلسل الهرمي لل.

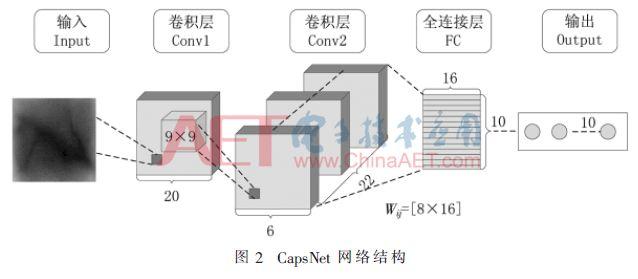

شبكة CapsNet هي ضحلة جدا، وطبقات التفاف مرتبطة ارتباطا كاملا بالإضافة إلى طبقة مجموع 3 طبقات. CNN على مستوى منخفض الأداء استخراج ميزة جيدة جدا، ويستخدم CapsNets خلافا للتميز "مثيل" كائن، لذلك هو أكثر ملاءمة لوصف الأمثلة المتقدمة. ولذلك، التقليدية CNN أضاف التفاف الميزة الأساسية طبقة في CapsNets الكامنة وراء قيام الاستخراج.

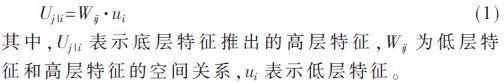

كما هو مبين، الميزات على مستوى منخفض من كبسولة الابتدائية، والبعد طبقة الثانية التلافيف هي 6 6 8 322، مع الخطوات 32 قيام 8 للفة 9 9 256 للمرشح 2 عملية المنتج، CNN، أبعاد طبقات 6 6 1 32 مع 6 6 32 عناصر، كل عنصر هو العددية، كبسولة، أبعاد طبقات 6 6 8 32 وهناك 6 6 32 عناصر، كل عنصر هو متجه 1 8، مخزن الأساسي ناقلات ميزة على مستوى منخفض.

من كبسولة الابتدائية إلى أرقام كبسولة، PrimaryCaps وDigitCaps متصل بشكل كامل، ولكن ليس مثل سكالارس CNN التقليدية والعددية المتصلة بهذا طبقة وصلة كاملة متصلة ناقلات وناقلات، ودينامية التوجيه خوارزمية التكرار 3 حسابات CIJ الانتاج 584 الجيش اليوغوسلافي.

أرقام كبسولة إلى الناتج النهائي، والذي يمثل طول محتويات احتمال وقوع تتميز مصنفة في القيام بذلك، مع إخراج L2 القاعدة من النواقل. CapsNets مبلغ احتمال عكس الناتج الشبكة العصبية التقليدي هو 1، لأن CapsNets لديها القدرة على تحديد عدد وافر من الكائنات.

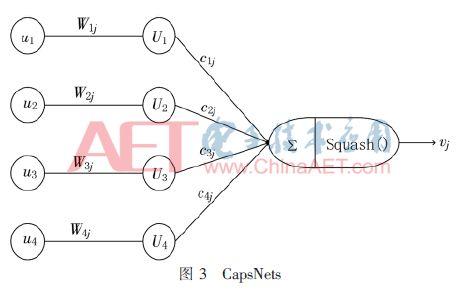

1.2 كبسولات

وتعتمد الشبكة العصبية لأول مرة على استخدام الناتج عددي واحد لجهاز الكشف عن ميزة تلخيص النشاط مجمع محلي المتكررة، وCNN ديك صورة واحدة صورة معالجة النزوح، والتناوب، وهما ينظر في FIG. ومع ذلك، يجب استخدام الشبكة العصبية في شكل ميزة متعددة الأبعاد هو "كبسولة"، هذه الكبسولات مدخلاته أداء بعض الحسابات الداخلية المعقدة جدا، ثم يتم تعبئتها نتائج هذه الحسابات إلى ثروة من المعلومات التي تضم انتاج النواقل. وسيكون لكل كبسولة تعترف حالة ومجموعة تشوه جزئي يعرف ضمنيا داخل الكيان البصري الفعال والتعلم، وإخراج مجموعة محدودة من خلاله المعلمة احتمال ومجموعة من الكيانات، ومجموعة من الشروط بما في ذلك الإضاءة المعلمات المادية النسبي لهذا الكيان البصرية، تعديل والموقف والتوجه دقيقة المعلومات. عندما تعمل الكبسولة بشكل صحيح، واحتمال وجود الكيان البصرية لديه ثبات المحلي، أي عندما يكون الكيان ظهور المحمول غطاء متعددة ضمن مجموعة محدودة من الكبسولة، لا يغير الاحتمالات. الكيان المعلمة "منحدر" والتغييرات مع ظروف المشاهدة، والأمثلة على المعلمة يكون هناك تغيير في المظهر المقابلة عندما يكون الكيان متعددة المحمول، والتي تبين إحداثيات الداخلية كمعلمات المثال كيان في مشعب المظهر، FIG 3 التين.

لنفترض أن كبسولة، وتتميز في هذا يتم الكشف عن الإصبع الوريد الصور، ومخرجات طول ثابت ناقلات ثلاثي الأبعاد. ثم يبدأ التحرك في الصورة الوريد. وفي الوقت نفسه، متجهة فراغ التناوب يمثل الكشف عن تغيير حالة من الوريد، ولكن سيظل طول ثابت، منذ كبسولات لا تزال مقتنعة بأن يكشف الوريد. والنشاط العصبي تغيير ككائن الصور المتحركة، ومع ذلك، فإن احتمال الكشف يبقى ثابت، الذي يقوم على أكبر مجموعة من CapsNets ثبات السعي لتحقيق ثبات، بدلا من التي تقدمها CNN.

1.3 وظيفة الاسكواش

تضم CNN ظيفة تفعيل المشترك ReLU، السيني وما إلى ذلك، لتحقيق تراكب الخطي المضغوط فقط بين 0 و 1 أو 1 و -1. في CapsNets، منذ أول شبكة النقل طبقة في شكل متجه، في ذلك الحاجة إلى تفعيل "كبسولة" إفعل الاتجاه المعالجة. CapsNets تفعيل وظيفة اسمه سكواش، كما هو مبين في التعبير (2):

1.4 الحيوي التوجيه

التشابه قياس المنتج نقطة من المدخلات والمخرجات من المدخلات والمخرجات من الكبسولة، ثم تحديث عامل التوجيه. العدد الأمثل من تكرار ممارسة ثلاث مرات. ديناميكية خطوة التوجيه هي:

(1) إخراج الصورة المدخلات بعد مغلفة في Uj | ط، R & لتر توجيه عدد من التكرارات.

(2) هو الذي يعرف بأنه احتمال الطبقة السفلى ل BIJ طبقة اتصال VNI VNj، القيمة الأولية 0؛

(3) تنفيذ الخطوة حلقة (4) من خلال الخطوة (7) مرات ص.

يمكن تحويله (4) VNI طبقة لتر، مع Softmax BIJ CIJ الى احتمال.

(5) ل VNj + 1 طبقة، SJ المرجحة الجمع.

(6) ل VNj + 1 طبقة، تم الحصول عليها باستخدام وظيفة تفعيل تنشيط SJ VJ.

(7) وفقا لفي Uj | العلاقة التحديثات BIJ ط والجيش اليوغوسلافي.

مع في Uj | i و الجيش اليوغوسلافي دوت تحديثات المنتج BIJ، عندما اثنين متشابهة، والمنتج نقطة كبيرة، BIJ أيضا يزيد من إمكانية ربط أقل VNI كبار VNj يصبح كبير، والعكس، عندما فجوة كبيرة بين البلدين ، والمنتج نقطة صغيرة، BIJ أيضا أصغر، منخفضة الارتفاع VNI إمكانية ربط رفيع المستوى VNj يصبح صغيرة.

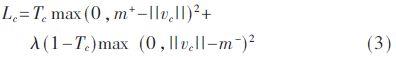

وظيفة 1.5 الخسارة

CapsNets SVM فقدان وظيفة مماثلة لوظيفة الخسارة، مثل صيغة (3)؛

من صيغة (3) يمثل نفس العينات الإيجابية والسلبية لتعظيم الفائق عن بعد. نظرا هنا نقطة المعايرة 2 و m + 0.9 = 0.1 = م-، وفقدان م المطلوب + عينات إيجابية في توقع 0.9، أكبر من 0.9 ليست هناك حاجة لمواصلة تحسين، سلبي التنبؤي 0.1 تجسيد م-، أيضا ما لا يقل عن 0.1 الحاجة إلى مواصلة وانخفض بعد ذلك. هو ثابت قيمة إلى 0.5، والقيم للاستقرار خلال التدريب، وذلك لمنع فقدان ابتداء كبيرة جدا، مما أدى إلى انكماش كل القيم الانتاج. البند صيغة اثنين مربع، لأن وظيفة الخسارة L2 القاعدة هي مجموع الخسائر الإجمالية لجميع الخسائر الطبقات.

تجربة 2

2.1 الإدراجات

مجموعة بيانات التجربة 584 هو 6 أصابع الفردية (باستثناء الإبهام والخنصر) ويتكرر الحصول على الصور لكل إصبع 20، أي حجم مجموعة البيانات هو 584 6 20. تدريب مجموعة من 60000، 00010 مجموعة الاختبار.

2.2 النتائج التجريبية

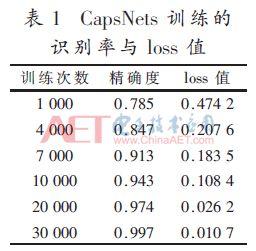

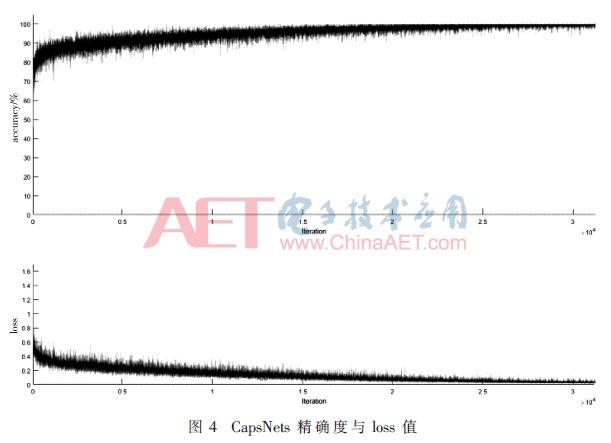

استخدام TensorFlow إطار المصدر المفتوح تهدف إلى تحقيق عمق والشبكات العصبية. 3 مرات في حلقة التوجيه والتدريب التكراري 31،000 مرات. معدل الاعتراف والقيم الخسارة هو مبين في الجدول 1.

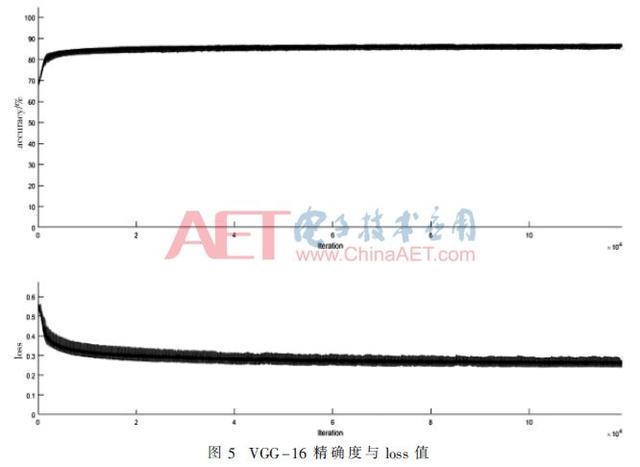

على التجربة برمتها NVIDIA Titanxp، CapsNet تدريب الوقت الذي يستغرق حوالي 6 ساعات، ويمكن أن ينظر إليها في الشكل (4)، الإحداثي السيني هو عدد التكرارات CapsNets ينسقون من الدقة وفقدان CapsNets قيمة، عندما كرر إلى 2000 مرة عندما بدء يقترب من 90 من الدقة، في حين كانت خسارة ما يصل الى 0.2، كما يزيد عدد التكرارات، ووصلت بسلاسة انخفضت الاهتزازات، وتتلاقى في النهاية إلى 98.6، في حين CONVERGES القيمة أيضا الخسارة المدهش أن 0.0107. الرقم 5 هو VGG 16 التدريب يمكن أن ينظر إليه مستقر نسبيا، إلا أن هذه الأخيرة لا تعلم كيفية تعزيز الدقة عند التكرار إلى 200 أضعاف دقة شبكة يقترب 84، وأخيرا دقة 85، في حين الخسارة قيمة ينخفض ببطء، وأخيرا فإن الخسارة الإجمالية في قيمة 0.21. كما هو مبين في الجدول رقم 2، بالمقارنة VGG-16، CapsNets مزايا واضحة (باستخدام نفس مجموعة البيانات التجريبية).

3 الخاتمة

أكد تجريبيا CapsNets مناسبة أفضل من الاعتراف الوريد CNN إصبع، نظرا لهيكل بسيط من الشبكة، بحيث أن سرعة التدريب تحسنت كثيرا. وفي الوقت نفسه، لأن الخصائص المكانية بحيث ميزات CapsNets الوريد واستخراج بشكل كامل، مما يزيد من دقة التعرف. لكن CapsNets في كثير من الأحيان متشابكا مع الخلفية معا، CapsNets لا تزال في مهدها، في أعمال مستقبل لهم، وربما في حالة من مجموعات البيانات الكبيرة عندما تكون هناك قضايا أخرى، لكننا تدخلت في CapsNets يجعل ظهور أبحاث في مجال الذكاء الاصطناعي خطوة كبيرة.

مراجع

KRIZHEVSKY A، SUTSKEVER I، HINTON G E.ImageNet تصنيف مع تلفيفي العميق مؤتمر .International على العصبية أنظمة معالجة المعلومات، 2012،60 (2): 1097-1105.

سيمونيان K، ZISSERMAN A.Very شبكات التلافيف عميق للاعتراف صورة على نطاق واسع .Computer العلوم، أرخايف: 1409.1556،2014.

SZEGEDY C، LIU W، Y جيا، وآخرون al.Going أعمق مع تلافيف مؤتمر .IEEE على رؤية الكمبيوتر والتعرف على الأنماط، 2015: 1-9.

وKaiming، تشانغ شيانغ يو، رن Shaoqing، وآخرون al.Deep التعلم المتبقية للاعتراف صورة جمعية الحاسبات .IEEE 2015.

وو تشاو شاو شي. الاعتراف إصبع أساس الوريد على عمق التعلم تقنية الكمبيوتر والتنمية، 2018 (2): 200-204.

هونج H G، M LEE B، PARK K.Convolutional العصبية الاعتراف الإصبع الوريد باستخدام القائمة على شبكة مستشعرات الصور NIR .Sensors، 2017،17 (6): 1-21.

ذكر له يو تشنغ بو، تشين هوا فنغ. خوارزمية الإصبع الوريد ميزة استخراج صورة هندسة الحاسب الآلي والتطبيقات، 2008، 44 (24): 175-177.

غونزاليس R C، E. WOODZ R معالجة الصور الرقمية . Ruanqiu تشى، وهلم جرا، بكين: الصناعة الالكترونية برس، 2007.

ون يان دونغ تشانغ Kaipeng ولى تشى فنغ، وآخرون al.A التمييزية نهج التعلم ميزة التعرف على الوجه لالعميق ملاحظات .Lecture في علوم الحاسب الآلي، الوثاب، 2016،47 (9): 499-515.

HINTON G E، KRIZHEVSKY A، S انغ D.Transforming لصناعة السيارات في الترميز مؤتمر .International على الشبكات العصبية الاصطناعية، 2011،6791: 44-51.

الصبور S، N FROSST، HINTON G E.Dynamic التوجيه بين كبسولات .NIPS2017،2017.

يانغ ليو قوه Shuxu، Zhangfeng تشون، وما إلى ذلك تستند على وسائل التحلل متفرق الوريد تقليل الضوضاء صورة معالجة الإشارات، 2012،28 (2): 179-185.

ROSDI B A، حي W S، والتعرف على الوريد SUANDI S A.Finger باستخدام خط المحلي نمط ثنائي .Sensors، 2011،11 (12): 11357-71.

AREL I، ROSE D C، T KARNOWSKI تعلم آلة P.Deep جبهة جديدة في بحوث الذكاء الاصطناعي .Computational الاستخبارات مجلة IEEE، 2010،5 (4): 13-18.

الكاتب المعلومات:

ذكر له يو تشنغ بو، نعمة سلم الدببة

(كلية الهندسة الكهربائية والإلكترونية، جامعة تشونغتشينغ وتشونغتشينغ 400050، الصين)