المصدر: قراءة العملية الأساسية

هذه المقالة عن 3000 كلمة ، اقترح القراءة 10 دقيقة .

هذه المادة سوف يشرح مفهوم الشبكة العصبية التلافيف (CNN) من خلال سلسلة من الصورة بجعة، واستخدام الصور تجهيز CNN على الطبقات المستقبلات العصبية الشبكة التقليدية.

تحليل صورةلنفترض أننا نريد لخلق نموذج الشبكة العصبية قادرة على التعرف على صورة البجعة.

سوان لديها بعض الخصائص، يمكن استخدامه للمساعدة في تحديد ما إذا كان وجود في الصورة بجعة، طويل العنق، على سبيل المثال، والأبيض ومثل.

لبعض الصور، فإنه قد يكون من الصعب تحديد ما إذا كانت هناك بجعة، نظرة على الصورة التالية.

هذه الميزات لا تزال موجودة في الصورة أعلاه، ولكن نحن من الصعب العثور على الميزات المبينة أعلاه. وبالإضافة إلى ذلك، سيكون هناك بعض الحالات الأكثر تطرفا.

على الأقل واللون هو نفسه، أليس كذلك؟ أو ......

لا ننسى هذه البجعات السوداء.

ويمكن أن يكون الوضع أسوأ ذلك؟ تماما.

حسنا، الآن لدينا ما يكفي من بجعة الصورة.

الحديث دعونا حول الشبكة العصبية.

الآن، كنا في الأساس بطريقة ساذجة جدا من الحديث عن ملامح الكشف في الصورة. شيدت الباحثون مجموعة متنوعة من تكنولوجيا الرؤية الكمبيوتر لمعالجة هذه القضايا: فرزت، FAST، SURF، موجز وهلم جرا. ومع ذلك، لم يكن هناك مشكلة مشابهة: كاشف إما عامة جدا أو كثيرا من التصميم، مما يجعلها سهلة جدا أو من الصعب التعميم.

وإذا علمنا أن الكشف عن وظيفة، وكيفية القيام به؟

نحتاج يمكن وصف دراسة (أو التعلم الميزة) النظام.

التعلم هو توصيف يسمح النظام لتجد نظرا للمهمة من الميزات المتعلقة بالتكنولوجيا تلقائيا. استبدال أعمال وظيفة اليدوية. هناك العديد من النصائح:

- غير خاضعة للرقابة (وسائل K، PCA، ......)

- إشراف (سوب. قاموس التعلم، والشبكات العصبية!)

على افتراض كنت معتادا على الشبكة العصبية التقليدية وتسمى الطبقات المستقبلات بالفعل (MLP) هو. إذا كنت لم تكن مألوفة مع المحتوى، ثم تستضيف مئات من الدروس على العمل MLP على الشبكة. هذه هي على غرار الدماغ البشري، حيث إتصال العقد من قبل التحفيز العصبية، ويتم تنشيط فقط عندما يتم التوصل إلى عتبة معينة.

MLP لديها العديد من السلبيات، ولا سيما في معالجة الصور. يستخدم MLP على المستقبلات (على سبيل المثال، بكسل في الصورة، تضاعفت بنسبة 3 في حالة RGB) لكل المدخلات. للصور الكبيرة، والوزن المناسب سرعان ما تصبح غير عملي. ل224 س 224 بكسل صورة وجود ثلاث قنوات اللون، يجب تدريب وزنا من حوالي 150،000! ونتيجة لذلك، صعوبات في التدريب وoverfitting.

مشكلة شائعة أخرى هي استجابة MLP مختلفة لإدخال (الصورة) والإصدار تحول - فهي ليست ثابتة translationally. على سبيل المثال، إذا ظهرت الصورة القط في الزاوية اليسرى العليا من الزاوية اليمنى السفلى من الصورة وصورة أخرى، فإن MLP محاولة لتصحيح نفسها ويعتقد ان القط تظهر دائما في هذا الجزء من الصورة.

من الواضح، MLP ليست أفضل فكرة لمعالجة الصور. مشكلة واحدة كبرى هي أنه عندما دكت الصورة كما MLP، يتم فقدان المعلومات المكانية. عقد بالقرب من المهم جدا لأنها تساعد في تحديد خصائص الصورة.

ولذلك، فإننا بحاجة إلى وسيلة للاستفادة من ملامح الصورة المكانية (بكسل) ذات الصلة، بحيث يمكننا أن نرى صورة القط، بغض النظر عن المكان يبدو. في الشكل أدناه، نحن نتعلم التكرار. هذه الطريقة ليست مثالية، لأنه قد تظهر القط في موقع آخر.

استخدام MLP للكشف عن القط، وتختلف مع تغير القطط الموقع.

CNN بداية جولةالآن دعنا ننتقل إلى CNN كيفية حل معظم المشاكل.

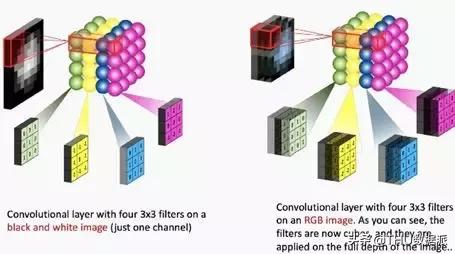

باستخدام ما يسمى مرشح، قمنا بتحليل تأثير بكسل المجاورة. باستخدام فلتر الحجم المحدد (بحكم التجربة هي 3X3 أو 5X5)، ثم يتم نقل مرشح من الزاوية اليمنى السفلى من الصورة. لكل نقطة على الصورة، على أساس تصفية التلافيف Calcd.

مرشحات قد تكون ذات صلة إلى أي شيء، لصورة الإنسان، وهو مرشح قد تترافق مع رؤية الأنف، وسيكون لدينا مرشح الأنف دعونا نرى قوة الأنف تظهر في الصورة، وكم والتي تحدث فيها الموقع. مقارنة مع MLP، مما يقلل من عدد من الشبكة العصبية يجب أن تعلم الأوزان، ويعني أيضا أنه عندما يتم تغيير موقع هذه الميزات، فإنه لن تتخلى عن الشبكة العصبية.

إذا كنت تريد أن تعرف كيفية التعلم من خلال شبكة من وظائف مختلفة، وعما إذا كانت الشبكة يمكن أن يتعلم الوظيفة نفسها (و10 مرشح رأس زائدة عن الحاجة بت)، وهذا في الأساس لا يحدث. عند بناء الشبكة، ونحن عشوائيا قيمة التصفية، ومن ثم تحديثها باستمرار خلال شبكة التدريب. إلا إذا كان عدد من التصفية المحدد كبير للغاية، وإلا فإن إمكانية اثنين من المرشحات متطابقة صغيرة جدا.

يتم إعطاء المثال التالي أو المشار مرشح النواة.

بعد تعيين الصورة على مرشح لتوليد ميزة لكل مرشح. ثم من خلال وظيفة تنشيط للحصول على هذه الوظائف، وتحدد وظيفة تفعيل الموقف من صورة معينة وجود ميزة. ثم نحن يمكن أن تفعل أشياء كثيرة، مثل إضافة المزيد من الطبقات والمرشحات لخلق المزيد من الخرائط الميزة.

ونحن إنشاء أكثر تعمقا CNN، أصبحت هذه الخرائط مجردة على نحو متزايد. يمكننا أيضا استخدام مجموعة من الطبقات المحددة لقيمة الحد الأقصى على عناصر FIG، واستخدامها كمدخل إلى طبقة لاحقة. من الناحية النظرية، أي نوع من العمليات يمكن أن يتم في طبقة تجميع، ولكن في الواقع، إلا أن تجمع أكبر لأننا نريد أن تجد القيم المتطرفة - وهذا هو شبكتنا عندما انظر الى هذه الميزة!

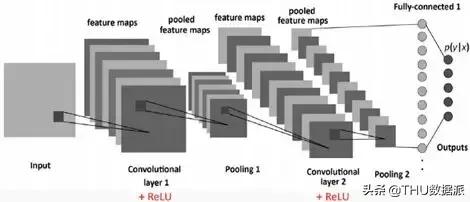

مثال CNN الإلتواء وجود طبقتين، وهما التصنيف النهائي للطبقة مشتركة ومرتبطة ارتباطا كاملا، فإنه يتم تحديد كصورة واحدة من عدة فئات.

ليكرر ما وجدناه حتى الآن. نحن نعلم MLP:

- لا يمكنك التوسع بشكل صحيح الصورة

- تجاهل المعلومات بكسل موقع المرتبطة الجار وجلبت

- لا يمكن معالجة الترجمة

CNN التفكير العام هو ملك التكيف بذكاء على الصورة:

- موقف حي بكسل وجود معنى الدلالي و

- يمكن أن تظهر عناصر من الاهتمام في أي موقف من الصورة

يتكون CNN أيضا من طبقة، ولكن الطبقات لا ترتبط تماما ل: لديهم مرشحات، على شكل مكعب مجموعة الصحيح الوزن التطبيق في الصورة بأكملها. ويشار إلى كل مرشح على أنها شريحة الأساسية 2D. هذه الفلاتر وقدم ثبات متعدية تقاسم المعلمة. كيف يتم تطبيقها؟ هو التفاف بالطبع!

الآن هناك سؤال: ماذا سيحدث حواف الصورة؟ إذا طبقنا التفاف على الصورة العادية، ونتيجة لأخذ العينات أداء وفقا لحجم التصفية. وإذا كنا لا نريد لهذا أن يحدث، وكيفية القيام به؟ يمكنك استخدام الحشو.

تعبئة يبين الشكل هذا كيفية تعبئة تملأ تماما والأمر نفسه ينطبق على CNNوتتميز في هذا نواة مرشح ولدت عن طريق تعيين بنفس حجم الصورة الأصلية على طبيعة التعبئة. وهذا مفيد لعمق CNN، لأننا لا نريد أن خفض الانتاج، ونحن لم يبق سوى شبكة اتصال 2X2 إلى التنبؤ النتيجة النهائية.

كيف يمكننا إجراء التصفية على اتصال؟اذا كان لدينا العديد من مخطط وظيفي، ثم كيف الجمع بين هذه الميزات لمساعدتنا على تحقيق النتيجة النهائية في الشبكة؟

وينبغي أن يكون واضحا أن كل مرشح وconvolved مع إدخال كامل 3D مكعب، ولكن سوف تولد 2D عناصر الخريطة.

- لأن لدينا عدد وافر من المرشحات، والناتج النهائي للحصول على 3D: حيث كل مرشح نسيج 2D.

- قد تختلف الملمس حجم الميزة على نطاق واسع من طبقة واحدة الى التفاف المقبل: أ 32x32x16 إدخال المدخلات طبقة، وإذا كانت طبقة تصفية 128، مخرج 32x32x128 الانتاج.

- Convolving الصورة مع مرشح يولد وأبرز إعطاء مخطط مميزة تظهر عناصر الرسم البياني المميزة موجودة في الصورة.

التفاف طبقة، ونحن أساسا استخدام عدد وافر من المرشحات على الصورة لاستخراج العديد من الميزات. ولكن الأهم من ذلك، نحن نتعلم هذه المرشحات! نحن نفتقد شيئا واحدا: غير الخطية.

يصف وظيفة خطية من المعدل (RELU)المعدل CNN الأكثر نجاحا غير الخطية هو دالة خطية (ReLU)، فإنه يمكن حل المشكلة تختفي التدرج التي تحدث في sigmoids. ReLU أسهل لحساب وتوليد تبعثر (ليس مفيدا دائما).

مقارنة بين طبقات مختلفةالشبكة العصبية التلافيف بطبقة من ثلاثة أنواع: طبقة الإلتواء، وطبقة الخلايا طبقة مرتبطة ارتباطا كاملا. هذه الطبقات يمكن أن يكون الأمثل كل طبقة لها معايير مختلفة، وينفذ المهام المختلفة على البيانات المدخلة.

يتم تطبيق فلتر طبقة التفاف على الخرائط الصورة الأصلية أو غيرها من عناصر الطبقات العميقة من CNN. هذا هو المكان الأكثر من المعلمات المحددة من قبل المستخدم في الشبكة. معظم المعلمة المهم هو حجم عدد النوى والنوى.

طبقة الخلايا مماثلة لطبقة الإلتواء، لكنها تؤدي وظيفة محددة، مثل خلية كحد أقصى، والتي تأخذ قيمة الحد الأقصى في منطقة محددة من مرشح، أو متوسط الخلية التي المتوسطات المنطقة التصفية. وتستخدم هذه عادة للحد من البعد الشبكة.

طبقة متصل تماما CNN ضعت قبل إخراج تصنيف، وتسطيح قبل الاعلان عن نتائج التصنيف. هذا هو مماثل لطبقة الناتج من MLP.

روابط ذات صلة:

https://towardsdatascience.com/simple-introduction-to-convolutional-neural-networks-cdf8d3077bac المحرر: هوانغ Jiyan تم التعليق بواسطة: لين يي لين - انتهى -تسينغهوا الانتباه - بيانات أكاديمية تشينغداو للعلوم قناة الصغرى الرسمية منصة الجمهور " بيانات الإرسال THU "أيتها الأخوات ولا". إرسال البيانات THU "لرعاية المزيد من المحاضرات ونوعية المحتوى.