نحن هندسة الشبكات العصبية يمكن أن يكون الأمثل، بحيث الذاكرة وحدود الحوسبة التكيف للمتحكم، و لا يؤثر على دقة. سوف نشرح واستكشاف عمق الشبكة العصبية التفاف فصل لتحديد الكلمات الرئيسية المحتملة في المعالج اللحاء-M في هذه المقالة.

الكلمة الإكتشاف (KWS) لتحقيق الأجهزة الذكية على أساس صوت التفاعلية المستخدم أمر بالغ الأهمية، تتطلب استجابة في الوقت الحقيقي وبدقة عالية لضمان تجربة جيدة للمستخدم. في الآونة الأخيرة، أصبحت الشبكات العصبية خيارا شعبيا للهندسة المعمارية KWS، بالمقارنة مع خوارزميات معالجة الصوت التقليدية، والشبكات العصبية دقة فائقة.

أنابيب الشبكة العصبية كلمة الإكتشاف

نظرا لتبقى "دائما على"، تطبيق KWS وميزانية السلطة محدودة جدا. على الرغم من أن تطبيقات KWS قد يعمل على مخصص عالية الأداء DSP أو وحدة المعالجة المركزية، ولكن هو أكثر ملاءمة لتعمل على ذراع اللحاء-M متحكم، والمساعدة على التقليل من التكلفة، الذراع اللحاء-M ميكروكنترولر في كثير من الأحيان الأشياء حافة لمهام أخرى.

ومع ذلك، لنشر KWS الشبكة العصبية على أساس ميكروكنترولر اللحاء-M القائمة، ونحن نواجه التحديات التالية:

1

يقتصر الفضاء

نظم القشرة-M توفر عادة ما يصل إلى عدة مئات من كيلو بايت من الذاكرة المتاحة. وهذا يعني أن كامل نموذج الشبكة العصبية، بما في ذلك الإدخال / الإخراج، والوزن والتنشيط، يجب أن تعمل ضمن هذا النطاق ذاكرة صغيرة.

2

الموارد المحدودة

لأن KWS للحفاظ دائما على المتطلبات في الوقت الحقيقي التي تحد من إجمالي عدد العمليات كل الشبكة العصبية المنطق.

ما يلي هو نموذجي هندسة الشبكات العصبية مناسبة لKWS المنطق:

1

الشبكة العصبية عمق (DNN)

feedforward DNN مستوى الشبكة العصبية، متصلا كومة كاملة من طبقات من الطبقة النشطة وغير الخطية.

2

الشبكة العصبية التلافيف (CNN)

على أساس واحد من العيوب الرئيسية لDNN KWS من المستحيل للجمعية محلية من وظائف الصوت، والارتباط نطاق الوقت والتردد المجال نمذجة العلاقة. CNN قد يكون مجال الوقت ومجال التردد الميزات مثل معالجة الصور المدخلات، وينفذ ما سبق عملية التفاف 2D للعثور على هذا الارتباط.

3

المتكررة الشبكة العصبية (RNN)

في العديد من المهام RNN تسلسل النمذجة يبدون الأداء الممتاز، وخاصة في التعرف على الكلام، والنمذجة اللغة والترجمة. RNN ليس فقط قادرة على إيجاد العلاقة الزمنية بين إشارة الدخل، ويمكن استخدام "المعزولة" آلية لالتقاط تعتمد على طول العلاقة.

4

التفاف الشبكة العصبية المتكررة (CRNN)

الشبكة العصبية التلافيف هي دورة الهجينة وCNN RNN يمكن العثور عليها في الارتباط الزماني / المكاني المحلي. تبدأ CRNN نموذج طبقة من الالتواء، فمن ثم RNN، ترميز إشارة، تليها طبقة كثيفة مرتبطة ارتباطا كاملا.

5

عمق التفاف فصل الشبكة العصبية (DS-CNN)

في الآونة الأخيرة، فمن المستحسن عمق الشبكة العصبية التفاف فصل كبدائل فعالة لمعيار عملية التفاف 3D، واستخدمت هندسة الشبكات المدمجة لرؤية الكمبيوتر.

DS-CNN تصفيتها أولا باستخدام منفصل 2D، وخصائص مدخلات من كل قناة في FIG حساب الإلتواء، ثم التفاف pointwise (أي 1x1-)، إخراج البعد العمق المشترك. بواسطة القياسية 2D و 3D التفاف التحلل اللاحق 1D، يتم تقليل عدد المعلمات والعملية، بحيث أعمق وأوسع العمارة ممكنة، حتى في متحكم لتشغيل الجهاز موارد مقيدة.

عند تشغيل كلمة الإكتشاف على اللحاء-M المعالج، واستخدام الذاكرة ووقت التنفيذ نوعان من أهم العوامل الهامة في تصميم وتعظيم الاستفادة من الشبكات العصبية لهذا الغرض، يجب أن تأخذ بعين الاعتبار هذين العاملين. وتظهر ثلاثة تقييد الشبكة العصبية أدناه للشركات الصغيرة والمتوسطة والكبيرة نظام اللحاء-M، وتكوين نظام نموذجي يستند اللحاء-M.

فئة KWS الشبكة العصبية نموذج (NN) فئة، على افتراض 10 مرات في المنطق الثاني و 8 الوزن / تفعيل

لضبط النموذج، حتى لا يتجاوز حدود الذاكرة والحوسبة متحكم يجب أن يؤديها على معلمة البحث. يجب أن يكون الأمثل فائقة يظهر الجدول التالي هندسة الشبكات العصبية والمعلمات المقابلة.

الشبكة العصبية فضاء البحث hyperparameter

أولا، إجراء استخراج ميزة البحث الشامل ونموذج الشبكة العصبية من المعلمات المفرط، ومن ثم إجراء اختيار يدوي لتضييق مساحة البحث، سواء المتكررة. ويلخص الشكل التالي كل هندسة الشبكات العصبية مناسبة لنموذج الأداء الأمثل ومتطلبات الذاكرة المقابلة والحساب. تقدم DS-CNN العمارة أعلى دقة، ولكن أيضا الذاكرة وموارد الحوسبة وأيضا أقل من ذلك بكثير.

الأمثل العلاقة نموذج الشبكة العصبية في الذاكرة والحسابي / المنطق

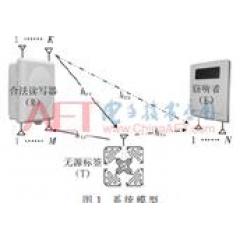

تطبيقات KWS اللحاء-M7 المنتشرة في مجلس التنمية STM32F746G-DISCO (كما هو موضح أدناه) على أساس، تحتوي على 8 الوزن DNN نموذج و 8 التنشيط، تنفيذ KWS الاستدلال 10 مرة في الثانية الواحدة خلال العملية. كل الاستدلال (بما في ذلك نسخ الذاكرة، MFCC استخراج ميزة، ينجز DNN) يستغرق حوالي 12 ميلي ثانية. لتوفير الطاقة، والسماح للمتحكم ينتظر بقية وضع وقت المقاطعة (WFI). KWS استخدامات تطبيق كامل حوالي 70 كيلو بايت من الذاكرة، بما في ذلك الوزن من حوالي 66 KB، لحوالي 1 KB تفعيل، ما يقرب من 2 KB من الصوت I / O وميزة MFCC.

KWS نشر اللحاء-M7 مجلس التنمية

وباختصار، يمكن ذراع اللحاء-M معالج تحقيق دقة عالية في تطبيقات التعرف الكلمات الرئيسية، في حين أن متطلبات الذاكرة والحسابية إلى حد ضبط هندسة الشبكات. تقدم DS-CNN العمارة أعلى دقة، ولكن أيضا الذاكرة وموارد الحوسبة وأيضا أقل من ذلك بكثير.