رابط الأوراق الأصلية

https://arxiv.org/pdf/1705.09914.pdf

ورقة أساسية

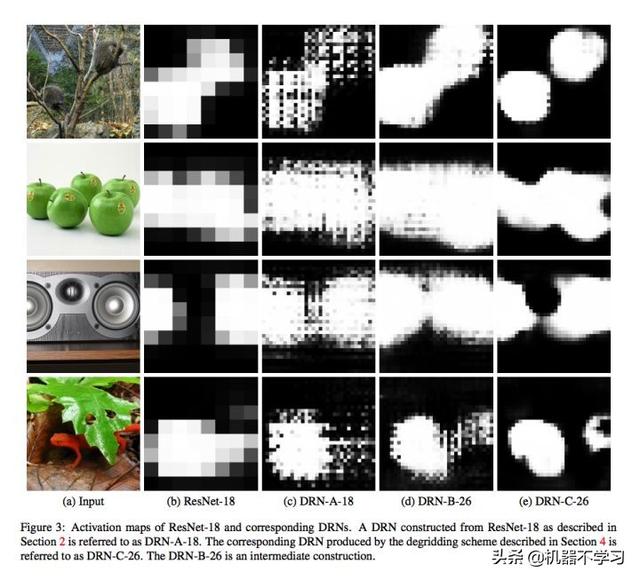

الإلتواء الأساسية "الشبكات المتبقية المتوسعة" من هذه الورقة هو مفهوم الإبداعية للالتفاف فارغ (المتوسعة الإلتواء) في ResNet مع الحفاظ على نفس القدر من المعلمات، مجال طبقة عرض التفاف كل مرحلة من نفسه، من قبل طبقة يمكن الحفاظ على ميزة كبيرة الحجم خرائط لتسهيل الكشف عن الأهداف الصغيرة، من أجل تحسين الأداء العام للنموذج. على وجه التحديد، ResNet، والطبقة الأخيرة من الخطوة لا يتجزأ الإلتواء 32 DRN (المتوسعة ResNet) 8 فقط. وبطبيعة الحال، لأن الخرائط ميزة كبيرة الحجم، وكمية من حساب بالطبع أيضا تصبح كبيرة، على الرغم من أن الكتاب تجنبها في ورقة، ولكن كقارئ حتى يعرفون ذلك.

ثانيا، ما هو التفاف فارغة

إشارة الروابط: كيف نفهم التفاف جوفاء (المتوسعة الإلتواء)؟

صورتين تتمكن من فهم ثانية: الاطفال، هل تعلم ذلك؟

مشترك التفاف أي تمدد = 1

الإلتواء أجوف أي تمدد = 2

زادت المسافة نقطة في تجويف من قبل نواة التفاف القيم تمدد، أي الوسيط-1 حيث تمدد فارغ، وهذا المكان خاليا، مع الحفاظ على المعلمات من الالتواء واحد لالتفاف مبلغ العملية دون تغيير، مع توسيع آفاق الإلتواء. ما يسمى ان هناك فوائد، من دون التفكير أيضا.

الفتيان والفتيات، هل تعلم ذلك؟

ثلاثة والتصميم DRN وتحسين

أولا، نحن ننظر ResNet، ويمكن تقسيمها إلى ست مراحل، وهي conv1 ~ 5 زائد طبقة تصنيف النهائية:

حيث conv2 ~ 54 هي نفس البنية، مكدسة حجم المتبقية بلوك، وسوف يتم أخذ عينات من كل مرحلة في خطوة = 2، فهو يجمع التأثير هو:

كيفية إلغاء النقطة الأولى منه مع الحفاظ على النقطة الثانية؟ تتم معالجة DRN على هذا النحو:

وفي الختام، وهي ما يلي:

ومع ذلك، على الرغم من هذا التصميم دون زيادة عدد المعلمات نموذج لتحسين دقة التعرف على نموذج لكائن صغير، ولكن هناك مشاكل واضحة، والكتاب دعوة degridding أدناه (ج):

من أجل القضاء على تأثير degridding فارغة جلب الإلتواء، تحسنت المؤلفون DRN:

خط عمودي الأخضر يمثل خطوة أخذ العينات المقبل = 2، يمكننا أن نرى، ثلاث عينات فقط تحت DRN كله. التحسن العام من حيث النقاط التالية:

2. DRN-B بالإضافة إلى الماضي هما 2،1 تمدد (الإلتواء أي العادي) من كتلة المتبقية، موصل DRN-C مزيد من طبقة إزالة القفز على أساس حد سواء، بحيث الإخراج fature النهائي خرائط حريري، كما هو مبين أدناه (د) (ه).

وهناك مشكلة صغيرة هي أن الصورة أعلاه هي الطريقة المطولة؟ NIN في AvgPooling + conv1x1 تصنيف بديل لدي انطباع توصيل إخراج طبقة كله ذلك؟ وهذا يجعل يتم تقليل معالم النموذج إلى حد كبير في نفس الوقت، وتحسين دقة هذا النموذج، والعديد من النماذج وتوقع الناتج تصنيف بهذه الطريقة، ونموذج تدريب لذلك، إلغاء AvgPooling، لكل نقطة على حجم ميزة خريطة x العرض، هذا الشكل هو (1،1، ج) استخدام conv1x1 الموتر الأصلي، ويمكن الحصول على هذا الرقم، يتم عرض هذه العملية أدناه:

أربعة، والأداء DRN

خصائص DRN كما هو مبين أدناه، يمكن أن ينظر إليه على مهمة الكشف عن وجوه، ونهائي عالية الدقة انتاج نموذج ميزة الخرائط لم تجلب عالية الأداء.

تصنيف صور

الكشف عن وجوه

تجزئة الدلالي

نقل: الشبكي: //zhuanlan.zhihu.com/p/66796313